2016년 이후 우리나라를 뜨겁게 달궜던 ‘가짜 뉴스.’

문제의 가짜 뉴스를 사람만이 만들 수 있다고 생각한다면 큰 오산이다. 최근 미국에서는 AI(인공지능)의 머신 러닝 기술을 통해 가짜 뉴스를 만들 수 있다는 우려가 확산되고 있다. 페이스북과 같은 SNS로 퍼지는 정보가 사실은 프로그래머가 만든 것일 수도 있다는 의미다.

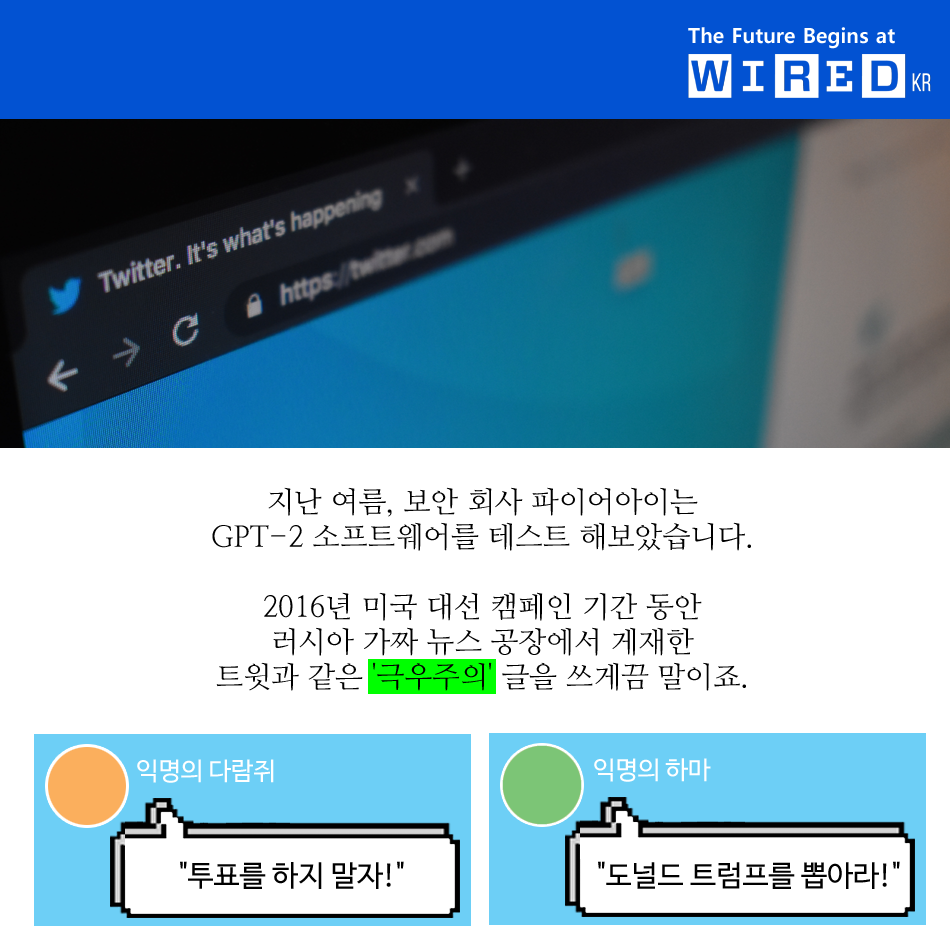

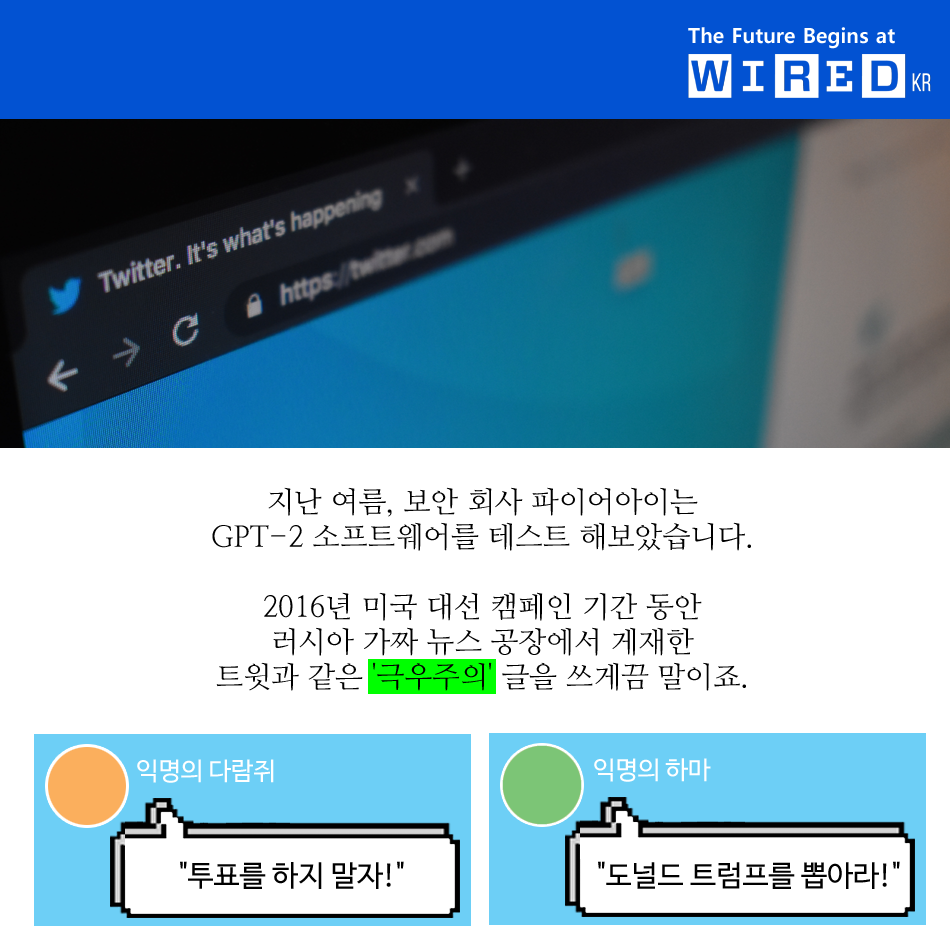

2019년 초, 미국에 위치한 OpenAI 연구소는 텍스트 생성 AI 소프트웨어인 GPT-2의 코딩 법을 공유하지 않겠다고 밝히기도 했다. 가짜 뉴스나 스팸 메시지 확산에 악용될 소지가 있어서였다. 이 위험을 시험하고자 미국 보안 회사 파이어아이는 GPT-2 소프트웨어를 테스트 해, 2016년 미국 대선 기간 동안 러시아 가짜 뉴스 공장에서 게재한 트윗과 같은 극우주의 선동을 퍼뜨리게끔 했다. GPT-2의 머신 러닝을 위해 이 회사가 읽힌 극우주의 글도 수백 개가 넘었다.

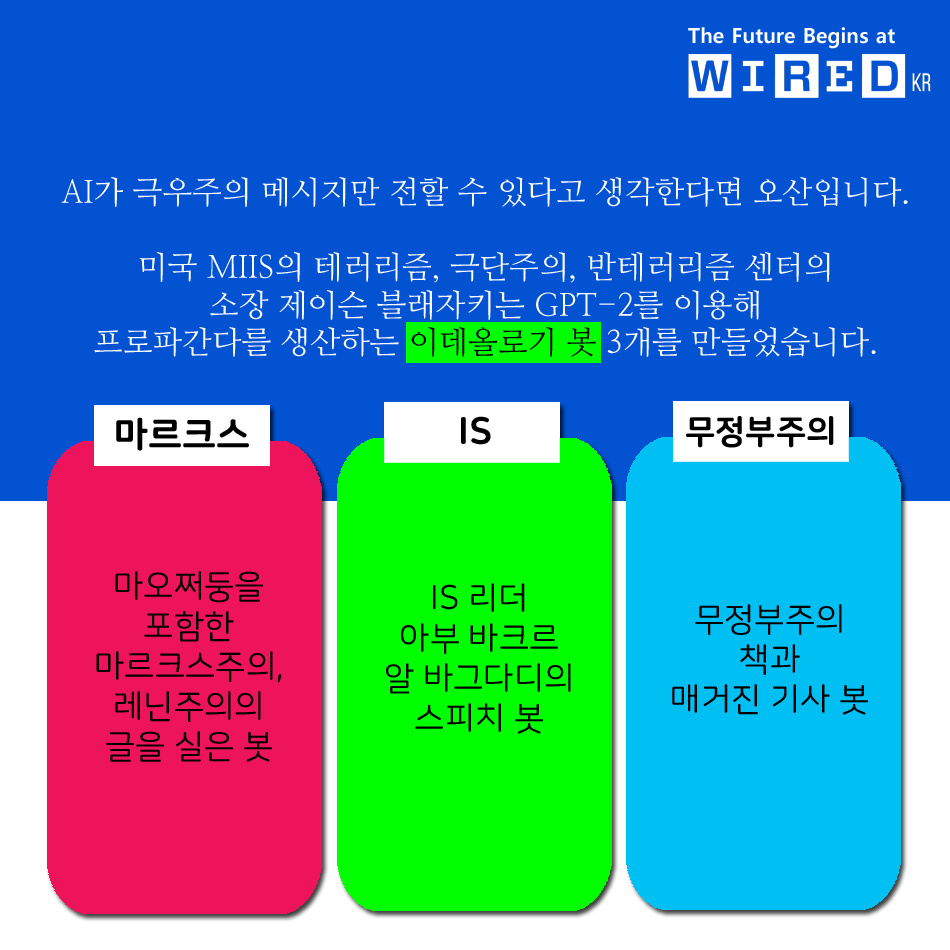

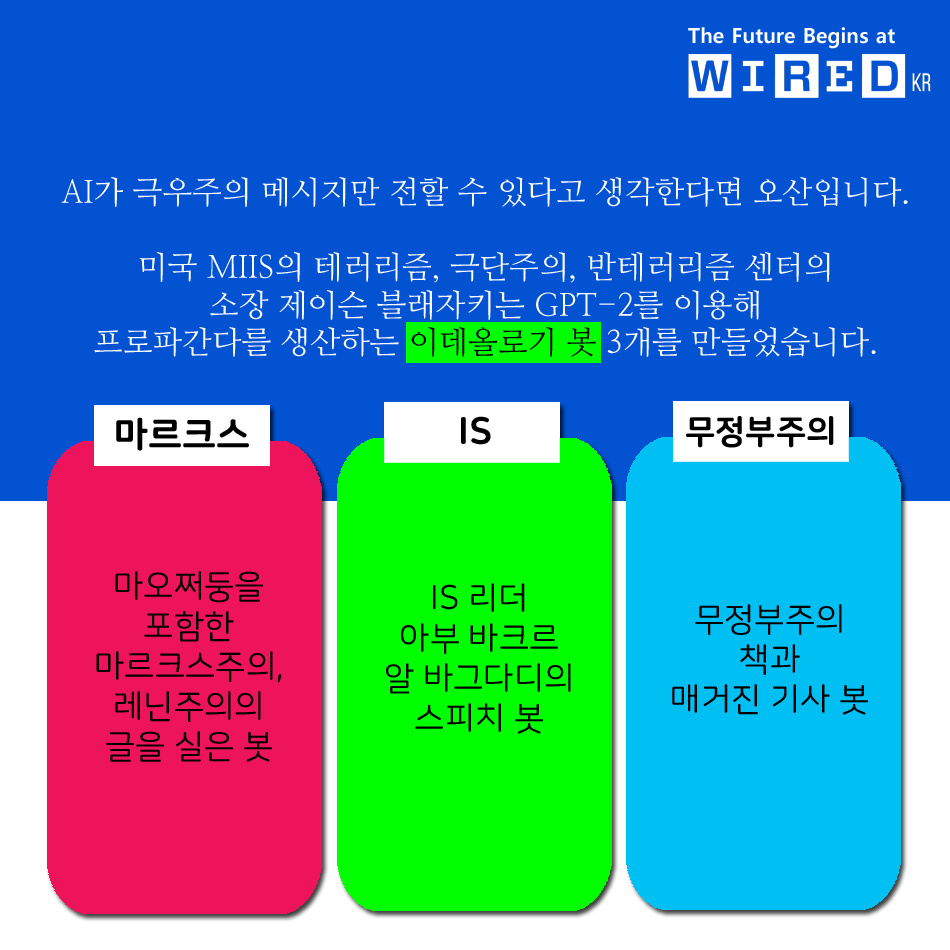

실험 결과, GPT-2는 어색할지 모르나 내용은 상당히 그럴듯한 가짜 뉴스를 완성했다. 이 모든 과정은 단 한 명의 인턴 직원이 진행했을 정도로, 큰 노력이 들어가지 않았다고 한다. 미국 MIIS 마이클 블래자키가 이끄는 연구진은 마르크스, IS, 무정부주의 아이디어를 유포할 수 있는 계정도 제작했다고 한다. 극우주의 관련 선동만 퍼뜨리지는 않는다는 뜻이다.

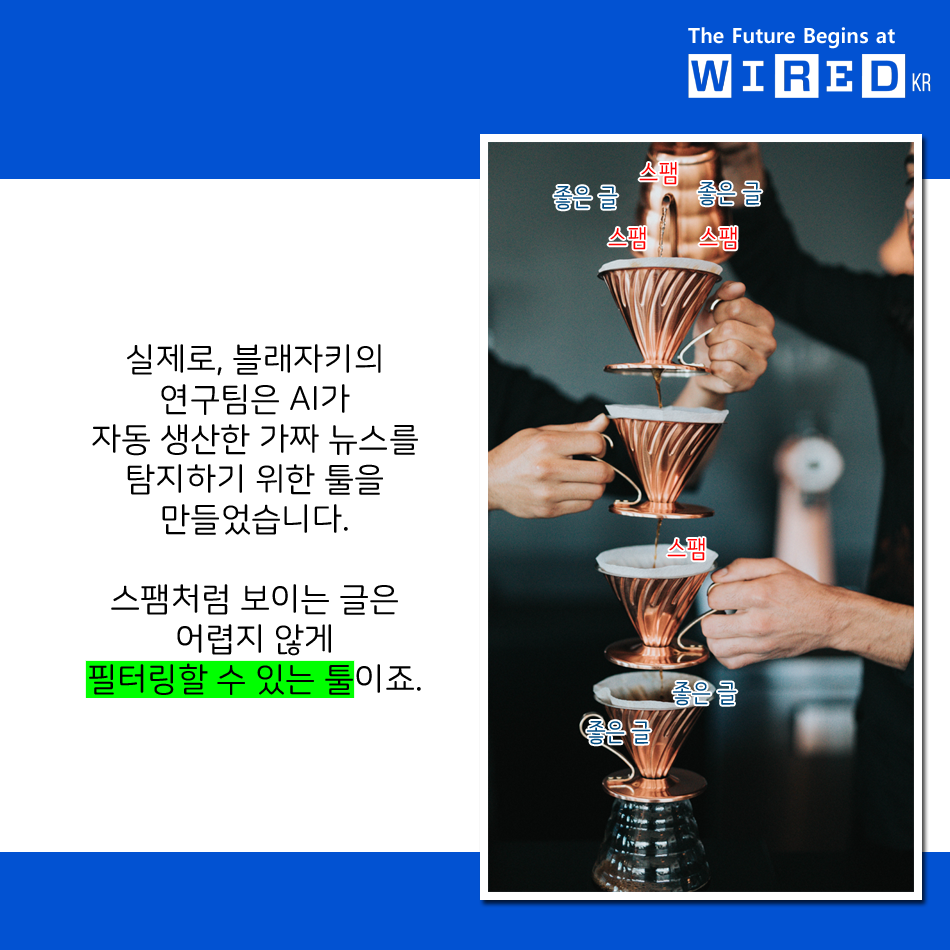

가짜 뉴스 확산 방지 툴도 있는데 사용할 수 있는 사람의 수가 적다는 게 문제다. AI 소프트웨어가 작성하는 글은 날이 갈수록 자연스러워지는 것과는 대조적인 상황이다. 과연 어떻게 대처해야 할까?

[참고 기사 및 링크]

To See the Future of Disinformation, You Build Robo-Trolls

Even the AI Behind Deepfakes Can’t Save Us From Being Duped

The Return of Fake News—and Lessons From Spam

뉴스레터 신청

뉴스레터 신청